Introdução

No dia 1º de abril de 2026, a missão Artemis II foi lançada às 19h35 (horário de Brasília) rumo à Lua, levando quatro astronautas de volta à órbita lunar após mais de 50 anos. A espaçonave Orion, lançada pelo foguete SLS, fez um sobrevoo ao redor da Lua antes de retornar à Terra, numa viagem de aproximadamente 10 dias. Dez dias depois, todos os quatro astronautas pousaram em segurança no litoral da Califórnia.

A tripulação foi composta pelo comandante Reid Wiseman, pelo piloto Victor Glover — o primeiro astronauta negro a viajar em direção à Lua —, por Christina Koch, a primeira mulher em uma missão lunar, e pelo canadense Jeremy Hansen. Uma missão histórica em todos os sentidos: a primeira vez, desde Apollo 17 em 1972, que seres humanos se aventuraram além da órbita baixa da Terra.

Mas a Artemis II não nasceu do improviso. Cada detalhe — do design do escudo térmico à rota de retorno — foi calculado, testado e validado à exaustão antes de qualquer astronauta sequer pisar no foguete. E é justamente aí que entra um personagem que raramente aparece nas manchetes sobre exploração espacial: a estatística.

Aperte os cintos e venha entender como ela esteve presente em cada etapa dessa missão — das decisões de engenharia à navegação no espaço profundo.

Conhecendo a missão Artemis II

Antes de entender o papel da estatística na missão, vale entender o que a Artemis II representou — e por que ela importa tanto.

A missão foi projetada como um voo tripulado de teste em espaço profundo: validar, com astronautas a bordo, o foguete SLS, a cápsula Orion, os sistemas de suporte à vida, as operações de navegação e os procedimentos de segurança antes de qualquer tentativa de descida na superfície lunar. Em outras palavras, a Artemis II não foi ao espaço para fazer história pelo espetáculo — foi para provar que o sistema funciona quando vidas humanas dependem dele.

A estratégia se baseia no SLS, um foguete de 98 metros de altura capaz de gerar força colossal para retirar da Terra a espaçonave Orion — uma cápsula projetada para manter quatro astronautas seguros em missões de até 21 dias no espaço profundo. Durante a missão, outra escolha importante foi a trajetória de retorno livre, que utiliza a gravidade da Terra e da Lua para assegurar que a nave voltasse automaticamente ao planeta mesmo em caso de problema nos motores. Nada foi deixado ao acaso.

E é exatamente aí que a estatística entra — não como coadjuvante, mas como alicerce de cada decisão tomada ao longo da missão.

Confiabilidade: a estatística que salva vidas

Antes de qualquer foguete decolar, engenheiros fazem uma pergunta que parece simples, mas esconde uma ciência inteira por trás: qual é a probabilidade de isso dar errado?

Essa é a essência da engenharia de confiabilidade — uma área da estatística dedicada a calcular e reduzir a chance de falhas em sistemas complexos. Pense assim: imagine que uma missão espacial depende de 100 componentes funcionando ao mesmo tempo. Se cada um tem 99% de chance de funcionar corretamente, a probabilidade de todos funcionarem juntos sem nenhum problema cai para menos de 37%. Em sistemas críticos, isso não é aceitável. A solução estatística para esse problema é a redundância: criar sistemas paralelos de backup que assumem o controle caso o principal falhe, aumentando drasticamente a segurança do conjunto.

Na Orion, essa lógica foi levada ao extremo. A nave conta com cinco computadores de voo independentes. Se todos os quatro principais falharem simultaneamente, um sistema de Backup Flight Software assume o controle — os engenheiros planejaram até para o cenário onde os próprios planos de contingência falham. Em outras palavras, existe um plano B para o plano B.

Essa mentalidade também esteve presente nos preparativos da missão. Em fevereiro de 2026, a NASA identificou uma anomalia ligada ao fluxo de hélio no estágio superior do SLS após um procedimento de rotina. O hélio é usado em operações críticas de pressurização, e qualquer comportamento inesperado vira sinal vermelho. A decisão foi pausar tudo, investigar e só retomar quando os números voltassem a indicar segurança suficiente. Para o público, pareceu mais um atraso. Para a engenharia, foi exatamente o processo funcionando como deveria.

Essa obsessão com segurança não é nova — ela foi construída ao longo de décadas, missão após missão. O gráfico a seguir mostra como a probabilidade estimada de falha por missão tripulada da NASA evoluiu desde os primeiros voos do programa Mercury até a Artemis II:

Observe que a probabilidade de falha caiu de cerca de 10% nos primeiros voos do Mercury para menos de 0,4% na Artemis II — uma redução de mais de 25 vezes em seis décadas. Cada tragédia, como o Challenger em 1986 e o Columbia em 2003, gerou revisões profundas nos modelos de risco e forçou a NASA a incorporar novas camadas de análise estatística ao processo de decisão. Na prática, a NASA estava comprando confiabilidade. E confiabilidade, em voo tripulado, vale mais do que espetáculo.

Navegação: como chegar à Lua sem GPS

As informações de posição da Orion são coletadas por sensores da espaçonave e enviadas ao centro de controle da missão, no Johnson Space Center, em Houston. Mas o que acontece entre uma medição e outra? Como a NASA sabe, a cada segundo, exatamente onde a nave está a 400 mil quilômetros de distância — num ambiente sem GPS, sem torres de sinal, sem qualquer referência fixa?

A resposta está em um algoritmo estatístico desenvolvido nos anos 1960, justamente para resolver esse problema: o filtro de Kalman. Durante uma visita ao NASA Ames Research Center, Rudolf Kalman viu a aplicação de suas ideias no problema de estimação de trajetórias para o Projeto Apollo, levando à incorporação do filtro no computador de navegação do programa. Mais de 60 anos depois, ele continua sendo peça central na navegação da Artemis II.

A lógica por trás do filtro é mais simples do que parece. Imagine que você está de olhos vendados dentro de um carro em movimento. Para saber onde está, você tem duas fontes de informação: a sua memória de onde estava antes — combinada com o quanto acha que se moveu — e uma indicação externa ocasional, como ouvir um sinal sonoro de um ponto de referência conhecido. Nenhuma das duas é perfeita: sua memória acumula erros ao longo do tempo, e o sinal externo também tem ruído. O filtro de Kalman resolve exatamente esse problema — ele combina as duas fontes, dá mais peso à que tem menos incerteza e chega a uma estimativa melhor do que qualquer uma sozinha. E faz isso continuamente, a cada novo dado recebido.

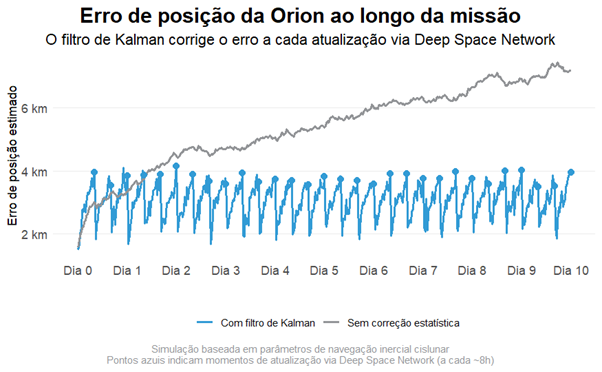

Na prática, isso significa que a cada vez que um sinal chega das estações de rastreamento da NASA — a chamada Deep Space Network, uma rede de antenas espalhadas pelo mundo —, o filtro incorpora essa medição, corrige a trajetória estimada e reduz o erro acumulado. O gráfico a seguir mostra exatamente essa diferença: de um lado, como o erro de posição cresceria indefinidamente sem correção estatística; de outro, o que o filtro de Kalman faz na prática a cada atualização recebida:

A diferença entre as duas linhas é a diferença entre uma missão bem-sucedida e uma nave perdida no espaço. Ao fim de 10 dias sem nenhuma correção, o erro acumulado tornaria a navegação inviável. Com o filtro, ele permanece controlado do início ao fim — invisível para os astronautas, mas presente em cada segundo do trajeto.

Conclusão

A Artemis II não foi apenas um feito de engenharia — foi uma demonstração prática do que acontece quando decisões críticas são tomadas com base em dados. Da probabilidade de falha de cada componente à trajetória corrigida milissegundo a milissegundo, a estatística esteve presente em cada etapa da missão, muitas vezes sem aparecer nas manchetes.

Essa presença não é exclusiva do espaço. A engenharia de confiabilidade que reduziu a chance de falha de 10% para menos de 0,4% em seis décadas, e o filtro de Kalman que manteve a Orion na rota certa a 400 mil quilômetros da Terra, são exemplos de como ferramentas estatísticas bem aplicadas podem ser a diferença entre o sucesso e o fracasso — em qualquer contexto onde decisões importantes precisam ser tomadas com base em dados imperfeitos.

Na Estat Júnior, utilizamos métodos estatísticos para transformar dados em informação de qualidade, auxiliando na tomada de decisão, na avaliação de riscos e na identificação de padrões que passariam despercebidos. Se você tem um problema que os dados podem ajudar a resolver, entre em contato com a gente.

Afinal, se a estatística consegue levar quatro pessoas à Lua e trazê-las de volta sãs e salvas, imagine o que ela pode fazer pelos seus dados!

Autor: Pedro da Costa Lacerda